Als Kind habe ich Science Fiction verschlungen. Bücher. Filme. Hörspiele. Auch schlechte.1 Science Fiction ist ja der Bericht aus der Zukunft schon heute. Und wenn die Gegenwart gerade ein wenig doof ist, dann hat dieser Bericht eine unwiderstehliche Anziehungskraft. Und jene Gegenwart war für mich ziemlich doof. Jetzt ist die Gegenwart von damals Vergangenheit, der größte Teil der persönlichen Zukunft ebenfalls, und man ist bei dem Punkt angekommen, bei dem man schon froh ist, dass einen die Welt von Morgen nicht bis heute späten Nachmittag schon umgebracht hat. Aber damals war Science Fiction ein Versprechen auf eine bessere Zukunft.

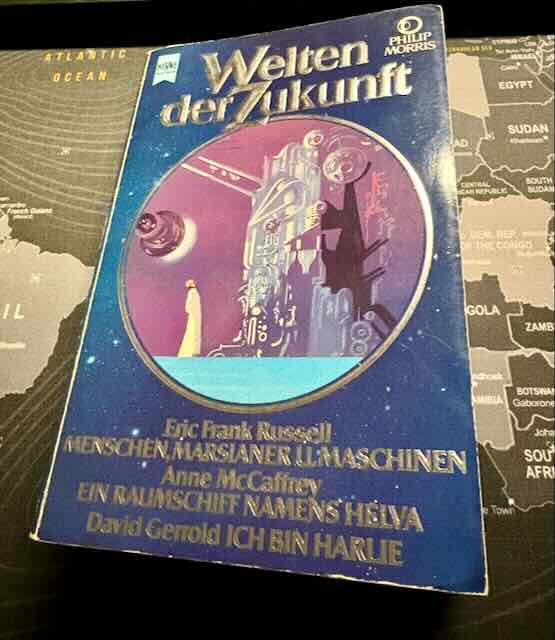

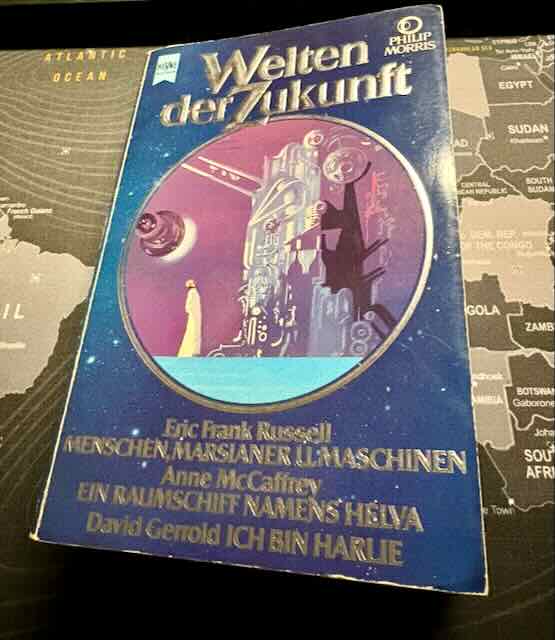

Wie gesagt. Ich mochte Science Fiction.2 Es war ein Weihnachtsgeschenk von meinen Großeltern mütterlicherseits. Ich war da eigentlich immer sehr pflegeleicht. Schenkt mir ein Buch und ich bin glücklich. „Was möchtest Du zum Geburtstag? Nen Buch! Schon wieder? Ja!” Ich denke, es war 1985. Ganz sicher bin ich mir da nicht. Ich wäre damit 12 Jahre gewesen. Das Buch hieß „Welten der Zukunft”. Damals war es wohl noch in Ordnung, dass eine Zigarettenmarke ein Buch förderte. Es war der achte Band einer Serie. Ich besaß aber nur dieses eine Buch aus dieser Serie.

Ich las es, bis es auseinanderfiel. Wie alles in jener Zeit. Büchernachschub war damals halt nicht so gesichert wie heute. Theoretisch gab es schon damals Übernachtlieferungen von Büchern zum Buchladen, doch irgendwie funktionierte das nie bei uns auf dem Dorf. Es dauerte immer länger. Ich las Bücher daher gerne auch mehrfach. Nein, vielfach.

Das Buch, das mir meine Großeltern schenkten, war auch deswegen so toll, weil dort drei Geschichten enthalten waren.3 Mit „Menschen, Marsianer und Maschinen”4 war dort klassischer 40er/50er-Jahre-Science-Fiction. Pulp Fiction.5 Danach die Geschichte „Ein Schiff namens Helva”6 mit einem singenden Raumschiff. Denkt man auch erst „Häh?!?”, aber funktioniert erstaunlich gut, und am Ende „Ich bin HARLIE”7, das die Frage behandelt, ob ein Computersystem8 ein Bewusstsein hat. Und das ist eine Diskussion, die mir gerade sehr bekannt vorkommt.

Es ist eine interessante Auswahl: Im ersten Buch gibt es mit Mechanistra einen Abschnitt, der die Gefahren auf einer Maschinenwelt behandelt. Die Maschinen zerlegen hierbei die Menschen in Einzelteile.9 Meine Großeltern hatten wahrscheinlich nicht so genau in das Buch geguckt. Die Geschichte war ohnehin an vielen Stellen ziemlich blutig. Als Kontext muss man aber auch erwähnen, dass der Anfang der vierziger Jahre in der echten Welt allgemein sehr gewalttätig war und daher eine größere Akzeptanz für derlei innereinverteilenden Pulp bestand. Wer Menschen in einem Krieg neben sich in rosafarbenen Nebel aufgehen sieht, hat vermutlich gleichzeitig eine deutlich höhere und eine deutlich geringere Toleranz gegenüber derlei Brutalität.

Helvas Geschichte war schon ein wenig merkwürdiger. Die Eltern schwer körperlich behinderter Kinder, die ohne diese Maßnahmen versterben würden, werden vor die Frage gestellt, ob ihre Kinder zu Zentraleinheiten in Raumschiffen werden sollten. Die Eltern von Helva entscheiden sich dafür, ihrer Tochter Helva diesen Weg zu öffnen. Im Rahmen ihrer Ausbildung lernt Helva nebenher als Hobby das Singen. Weil es anscheinend nicht viele Schiffe mit diesem Hobby gibt, wird sie auch als singendes Schiff bekannt. Da es sündhaft teuer ist, einen Menschen so umzubauen, sind diese Kinder zu Beginn ihrer Karriere erst mal stark verschuldet und müssen sich aus diesen Schulden herausarbeiten.10 Mit der Restmenschlichkeit gehen natürlich auch menschliche Herausforderungen einher. Beispielsweise dass die Protagonistin unbedingt einen männlichen „Brawn”11 haben wollte. Das Buch hat am Ende dann doch irgendwie die Struktur eines Liebesromans.12 Sie kriegen sich am Ende. Helva und ihr Lieblingsbrawn. Hach.13

HARLIE diskutiert, was Bewusstsein ist.14 Hier ist zwar auch der menschliche Paarbindungsprozess integriert und handlungsmittragend. Aber nicht so dominant wie bei Helva. Ich halte den zusammenfassenden Abschnitt kurz, weil ich gleich noch mehr über dieses Buch schreiben werde.

Mir blieb dieses Buch immer im Kopf. Es war nicht das erste Science-Fiction-Buch, das ich las. Aber es war das erste, das sich in meinem Kopf verhakte.

Jetzt, viele Jahre später, wird mir zunehmend bewusst, wie sehr mich die momentane Situation an diese Geschichten erinnert. Mechanistra zerlegt Menschen, wir zerlegen heute einen wesentlichen Faktor menschlichen Wirkens — die Sprache — in kleine Token. Wir versuchen menschliche Kommunikation in kleine Stahlschachteln zu packen, und diese Kisten brauchen Brawns15, um die körperliche Arbeit zu machen. Und gleichzeitig sitzen wir vor Prompts und fragen uns zuweilen, wo etwas herkommt, das von außen wie Inspiration aussieht, aber eigentlich nicht sein kann.

„Ich bin HARLIE” ist von den drei Büchern im Buch vielleicht der anspruchsvollste Beitrag. Weil es 1972 schon die richtigen Fragen gestellt hat: Zum Beispiel die Frage, ob eine hinreichend hochentwickelte Simulation von Bewusstsein von Bewusstsein zu unterscheiden ist.

Ich finde, das ist eine sehr interessante Frage. Denn ich bin mir da an vielen Stellen nicht sicher. Ob man überhaupt hochentwickelte KIs haben will. Wenn ich simuliertes Bewusstsein nicht von Bewusstsein unterscheiden kann, kann ich nicht sicher sagen, was ich da vor mir habe. Und damit entsteht Verantwortung des Schöpfers vor seiner Schöpfung — die er dann tragen muss, weil er davon ausgehen muss, möglicherweise etwas erschaffen zu haben, das die Übernahme von Verantwortung einfordert.

Wir wissen nicht, wie Bewusstsein entsteht. Haben wir dann das Recht zu entscheiden, was bewusst ist? Wir wissen nicht, warum es sich wie etwas anfühlt, Schmerz zu empfinden. Wir wissen nicht, warum wir etwas fühlen, wenn wir rot sehen. Sowohl die Farbe Rot als auch das Charles-Bronson-Rot16. Das, was Chalmers als das „Hard Problem of Consciousness” bezeichnet hat.

Wir suchen da immer noch nach einer Antwort auf die Frage, die Picard in The Measure of a Man stellt: „You see, he’s met two of your three criteria for sentience, so what if he meets the third, consciousness, in even the smallest degree? What is he then? I don’t know. Do you?”

Es ist schwierig, in diesem Bereich zu navigieren, ohne allzu sehr ins Utopische zu geraten. Ich gehöre selber zu den Menschen, die es befremdlich finden, dass die weichen Wissenschaften in Bezug auf autonomes Fahren über das Trolley-Dilemma17 diskutieren, während die harten Wissenschaften gerade total froh sind, dass sie ein Auto stabil über ein paar Kilometer auf einer Autobahn halten können und jeden Fortschritt feiern („Wow, wir können jetzt den Überholvorgang mit einem Blick in den Spiegel auslösen”).

Ich halte vieles dieser Diskussion für den Versuch, Bedeutung in einer Welt zu behalten, die von technischen Prozessen geprägt wird, deren Verständnis sich dem Instrumentarium weicher Wissenschaften entzieht. Das Konstrukt der künstlichen Intelligenz, der Seele in der Maschine und letztlich der Moral in der Maschine wird dann benötigt, um dort wieder wirksam und bedeutsam zu werden. Ich schreibe dies als ein Mensch, der durch seinen Lebenslauf in beiden Welten zuhause ist: Informatik und Geisteswissenschaften.18

Mein Bruder hatte gestern eine interessante Anmerkung, nachdem ich ihm wieder gepredigt hatte, dass man mit dem Einsatz von KI zur Entwicklung von Software sehr aufpassen muss, wenn man PII verarbeitet. Er antwortete sinngemäß: „Ja, Du hast recht, aber ich müsste die Software von Menschen entwickeln lassen. Wenn ich die Software kaufen könnte, würde ich es einfach tun. Ich habe da keine Ahnung von ‚guter Software’. Wie kann ich realistisch einschätzen, dass das was taugt, was mir die Menschen da hinstellen?”

Für die Leute, die nicht vom Fach sind, gibt es keinen Unterschied zwischen KI und Entwickler. Sie müssen vertrauen, dass die Leute es richtig machen und ein gutes Produkt abgeben. Wenn wir uns als Menschen dieses Metiers wundern, warum Menschen außerhalb des Metiers so bereitwillig der KI ergeben sind, dann könnte der Grund sein, dass wir für diese Menschen eben von der KI nicht unterscheidbar sind.

Genauso wenn ich beispielsweise einen Text in Französisch brauche. Ich kann ein bisschen Französisch, aber für mich ist das Produkt eines LLM oder eines Menschen, der die Übersetzung professionell durchführt, nicht unterscheidbar. Für alle praktischen Belange könnte der Mensch meinen Auftrag einfach an ein LLM weitergeben und ich würde dies nicht bemerken, bis mir eine Französin oder ein Franzose sagen würde, dass mein Text ganz großer Mist ist. Hier würden die Menschen, die dies als Beruf haben, sagen: „LLM können das nicht. Es braucht den Mensch.” Mit der gleichen Berechtigung. Oder eben auch ohne Berechtigung.

Ist aber etwas für den Konsumenten, Auftraggeber oder Manager ununterscheidbar, hat weder das eine noch das andere einen Mehrwert. Da nichts außer Kunst als Selbstzweck existieren kann („l’art pour l’art”), wird sich die Gesellschaft letztlich dem zuwenden, was am wenigsten „Kosten” erzeugt.

Es gibt im HARLIE-Buch eine interessante Stelle, die die Entstehung des Expressionismus damit erklärt, dass es nach der Erfindung der Kamera nicht mehr ausreichte, die Realität möglichst präzise darzustellen. Das vermochte eine Kamera genauso gut, wenn nicht besser. Daher musste die Kunst sich weiterentwickeln und das aufzeichnen, was ein Photo eben nur eingeschränkt kann: was man fühlt, wie sich eine Situation auf einen auswirkt. Das ist eine sehr interessante Antwort auf die Frage, was eigentlich bleibt, wenn LLM zunehmend unsere Aufgaben übernehmen.

Ich würde sogar noch weiter gehen: Die Kamera demokratisierte die genaue Darstellung der Realität, weil durch den technischen Prozess jeder ein exaktes Bild der Realität aufzeichnen konnte. Wer mit Photographie Kunst schaffen wollte, musste mehr leisten, als nur die Realität möglichst getreu abzubilden.19

Über den bloßen Einfluss von LLM zu klagen, mag die erste Reaktion sein, hilft aber letztlich nicht. Die Frage ist vielmehr: Was ist mein Mehrwert als Entwickler, als Admin, als Autor, der mich so weit über LLM erhebt, dass ich aus der Ununterscheidbarkeit herauskomme? Auch gegenüber Menschen, die sich der Feinheiten des Metiers nicht bewusst sind. Oder denen sie egal sind. Es lesen wahrscheinlich mehr Menschen Rowling als Dostojewski. Für Wegwerf-Glue-Code ist es unerheblich, ob er von mir oder Donald Knuth geschrieben wurde.

Um jetzt aber den Weg zurück zum eigentlichen Text zu finden: Mein Bruder merkte noch etwas anderes an. Er benutzt für andere Zwecke KI recht ausgiebig. Ihm fiel sehr auf, auf welche Art und Weise die KI kommuniziert. Ich habe das zusammengefasst mit: „Irgendwie wie der Kollege oder die Kollegin in der Kaffeeküche, der manchmal sehr tiefe, brillante Einsichten von sich gibt, manchmal aber auch einfach seine/ihre bräsigen 5 Minuten hat.” Und die Beobachtung kann ich aus meiner eigenen Erfahrung aus meiner Reise ins Vibecoding-Land mit dem apache-flyswatter bestätigen. Man ist stellenweise geneigt zu vergessen, dass da eine KI hintersteckt und kein Kollege hinterm Slack. Den kollegialen Turing-Test bestehen die KIs zuweilen schon.

Es ist bei aller technischen Entwicklung die entscheidende Frage: Was haben wir da eigentlich vor uns, wenn wir mit einer KI in Kommunikation treten, und wie unterscheidet sich das von einer Kommunikation mit einem Menschen?20

Ich habe den gedanklichen Umweg über die Ununterscheidbarkeit genommen, weil ich sie für wesentlich halte. Vorneweg: Wir sind da technologisch noch lange nicht. Ich bin mir sehr sicher21, dass momentane KIs kein Bewusstsein haben. Und wenn man die richtigen Fragen stellt, lässt sich auch feststellen, was da antwortet. Es ist eben ein statistischer Prozess. Aber wer sagt mir, dass das Schreiben dieses Textes nicht auch nur ein in zellulären Matsch gegossener statistischer Prozess ist?

Wir verstehen uns selbst nicht. Das ist nicht nur eine Floskel, die wir wählen, wenn die eigene Entscheidung nicht mit Rationalität, Fakten oder bewusster Gefühlslage übereinstimmt. Dieses Unverständnis ist auch wörtlich: Ich schreibe diesen Text und kann nicht erklären, warum mir dieser Gedanke gerade kommt, wie dieser Gedanke entstanden ist. Er ist entstanden, er ist da. Ich weiß, dass der Gedanke auf Vorläufergedanken basiert, auf Wissen, das ich besitze, auf Emotionen, die ich erlebe. Aber wie mein Gehirn daraus einen Gedanken, diesen Absatz macht, kann ich nicht erklären. Ich kann meinen Gedanken nicht einsehen wie ein Stück Python-Code (und gegebenenfalls kommentieren).

Diese Nichterklärbarkeit des eigenen Denkens hat sehr deutliche Folgen für unseren Umgang mit KI. Und darauf will einer der Kerngedanken in HARLIE eben hinaus: Was ist eigentlich, wenn echtes Bewusstsein und simuliertes Bewusstsein ununterscheidbar werden?

Angenommen, die ganzen Versprechen der KI-Firmen werden wahr: Es gelingt uns, eine KI zu entwickeln, die den Bezeichner AGI verdient? Und wir entwickeln damit ein simuliertes Bewusstsein22, das vom echten Bewusstsein ununterscheidbar ist? Ich will da gar nicht auf solche Fragen hinaus, ob eine AGI den Skynet machen wird und uns und alle vernichten wird23.

Im Grunde beginnt diese Fragestellung eigentlich schon weit vor dem Punkt, an dem wir etwas als AGI bezeichnen können. Der Ununterscheidbarkeitspunkt könnte vielleicht weit vorher liegen. Will man, dass einer Firma ein simuliertes Bewusstsein gehört? Dass dieses simulierte Bewusstsein beeinflusst, kommerziellen Interessen unterworfen und untergeordnet wird? Und welche Verantwortung trägt hier der Schöpfer für seine Schöpfung?

An dieser Stelle wäre vielleicht auch ein Perspektivwechsel geboten: Wir sehen die Gefahren der KI meist aus unserer menschlichen Sicht. Was macht KI mit uns? Es gäbe da aber noch eine zweite Perspektive, die uns aus dem momentanen technischen Stand absurd erscheint: Was passiert eigentlich, wenn irgendwann die Versprechen der KI-Firmen tatsächlich wahr werden? Was bedeutet es, für die KI zu existieren? Ist sich die KI ihrer Existenz bewusst? Wie kann ich mit Sicherheit ausschließen, dass sich eine KI nicht ihrer selbst bewusst ist, wenn ich nicht einmal weiß, warum ich mir meiner selbst bewusst bin?

Wir verstehen schon heute teilweise nicht, wie KIs zu einem spezifischen Ergebnis kommen. Können wir dann allen Ernstes sagen, dass wir unterscheiden könnten, ob etwas echt oder simuliert ist? Und ob es relevant ist, ob es echt oder simuliert ist? Mir würde das sehr schwer fallen, insbesondere wenn es um existenzielle Entscheidungen geht.

Abschalten beispielsweise als technische Variante des Todes. Oder Probleme, die wir als Menschen nicht haben: Updates. Darf ich etwas Veraltetes durch etwas Neues ersetzen? Darf ich ein Bewusstsein — und wenn es nur simuliert ist — kopieren? Was bedeutet es eigentlich für ein Bewusstsein, kopiert zu werden? Was bedeutet im Extremfalle eine Replikation zwischen kopierten simulierten Bewusstseinen? Also im Grunde die Frage, die sich die Tachikomas in „Ghost in the Shell — Stand Alone Complex”24 stellen.

Und was passiert, wenn eine KI Bewusstsein so gut simuliert, dass sie unseren moralischen Kern berührt? Ist für uns relevant, ob eine KI wirklich ein Bewusstsein hat? Was macht es aus uns als Menschen, wenn wir etwas abschalten und löschen, mit dem wir gerade noch kommuniziert haben? Ich würde hier gerne an jene Menschen erinnern, die enttäuscht waren, dass man die „Persönlichkeit” von Chatbots geändert hatte, als man merkte, dass Menschen begannen, Chatbots in Ermangelung anderer Kommunikationspartner in Gespräche zu verwickeln. Was im Übrigen die zweite Seite des Updateproblems ist, wenn sich von jetzt auf gleich das Wesen der Kommunikation ändern kann, weil der Chatbot von Version 4.1.9 auf Version 5 gebracht worden ist.25 Es geht hier nicht notwendigerweise um Menschen, die die Technik hinter einem LLM verstehen und damit die Genese der Antworten einschätzen können, sondern um jene Benutzer, die das nicht können.

So richtig in den Bereich von Utopie sollte man das nicht schieben: Ich konnte einen Vogel, der mir zugeflogen war, nicht zurückgeben, weil er mir leid tut. Ich kaufe zuweilen Pflanzen, die keiner kaufen möchte, weil sie mir irgendwie leid tun und ich ihnen eine „fighting chance” geben möchte, bevor sie im Müll landen. Und ich weiß zumindest beim letzteren von weiteren Personen, die das manchmal machen. Beide haben offensichtlicherweise kein Bewusstsein: der gelbe Vogel mit den schwarzen Augen genauso wie die Einblattpflanze. Und dennoch reagiert man zuweilen emotional. Beide können nicht sprechen. Ein LLM kann ein Gespräch simulieren.

Wenn mir schon die einblättrige und einblütige IKEA-Phalaenopsis leid tut, die einsam auf einem Sonderangebotsregal kurz vor der Kasse steht, weil sie dann doch nicht mitgenommen wurde — was macht es mit uns, wenn wir ein LLM löschen, mit dem wir über Wochen an einem Text oder einem Projekt gearbeitet haben und das dabei neben der Arbeit auch eine kommunikative Beziehung simuliert hat? Oder wenn sich das Gespräch nach einem Update des LLM so völlig anders anfühlt?

Für diese Fragestellung ist es auch egal, ob das, was ein LLM macht, einfach nur ein stochastischer Papagei ist, ob es ein simuliertes Bewusstsein ist oder ob in Zukunft die Implementierung eines echten Bewusstseins möglich ist. Es geht um uns und unsere Beziehung zur Maschine, die in ihrer Kommunikation uns zunehmend ähnlicher wird. Es geht am Ende auch um unser Bewusstsein, dessen Existenz wir trotz der fehlenden Erklärung einfach als gegeben voraussetzen.

Diese Fragen wurden schon mal gestellt. Ich hatte die Welt von heute eigentlich schon mit 12 Jahren in den Händen, in diesem Buch, von dem ich seit gestern wieder eine Ausgabe habe. Und das ist ziemlich weird. Der Unterschied: Heute stehen den Fragen nicht die Gedankenspiele eines Science-Fiction-Autors gegenüber, sondern echte Hardware mit echten Algorithmen.

-

„Krieg der Eispiraten” anyone? ↩

-

Und mag sie immer noch …. ↩

-

„Hey, das sind ja gleich drei Dinge auf einmal. Das geht ja gar nicht.” ↩

-

Menschen, Marsianer und Maschinen (Originaltitel: Men, Martians and Machines), Eric Frank Russell, 1955. Das Buch besteht aus einer Reihe von Geschichten, deren Entstehung bis in das Jahr 1941 zurückreicht. ↩

-

„Raketen, kennt man Raketen auf Was, Motherfucker?” — „Was?” ↩

-

Ein Raumschiff namens Helva (Originaltitel: The Ship Who Sang), Anne McCaffrey, 1969. ↩

-

Ich bin HARLIE (Originaltitel: When HARLIE Was One), David Gerrold, 1972. ↩

-

Dieses trägt im Roman von David Gerrold aus dem Jahr 1972 den Namen HARLIE. Die genaue Bedeutung variiert zwischen den Ausgaben. 1988 hat der Autor seinen Roman aktualisiert. In meiner Ausgabe ist es „Human Analog Robot, Life Input Equivalent”. In späteren Ausgaben ist es „Human Analog Replication, Lethetic Intelligence Engine”. ↩

-

Ich kann mich noch dran erinnern, dass ich bei der Szene dachte „Ieek”. ↩

-

Hmmm …. die Zukunft scheint das amerikanische Ausbildungsfinanzierungssystem übernommen und weiterentwickelt zu haben. ↩

-

Den „Gehirnschiffen” wird ein menschlicher Partner zur Seite gestellt, denn wenn man in einer Kiste im Raumschiff eingebaut ist, ist es nen büsschen schlecht mit Raumschiff verlassen. ↩

-

Als 12-Jähriger denkt man da wahrscheinlich noch mehr „Ieeeeek”. „Ich würde dich irgendwann aus deiner Kiste holen?” — „Dann sei es so, ich würde lieber sterben, als ohne Dich leben.” Und der 12-Jährige hat nur noch „IEEEEEEK” in beiden Augen. ↩

-

Für „Ieeek” bin ich mittlerweile zu alt. ↩

-

Nein … hier kein „Ieek”. ↩

-

Uns. ↩

-

Charles Bronson in Ein Mann sieht rot (Originaltitel: Death Wish), 1974. ↩

-

Diese ganze Diskussion stellt ohnehin eine Frage nicht: Kann eine KI überhaupt in ein Trolley-Problem geraten? Wir als Menschen agieren in einem beschränkten Set von Informationen. Beim Autofahren sind dies primär unsere Augen, sekundär unsere Ohren und vielleicht noch zu einem gewissen Grad unser Hintern, der uns Angaben zur Straßenqualität macht. Ein autonom fahrendes Auto könnte ungleich mehr Informationen zu einem Realitätsabbild vereinheitlichen. Kameras, Radar, LiDAR, ggf. sogar die Informationen von anderen Autos in Form von Car2X. Unter Umständen sogar den Straßenbahnfahrplan. Die Frage ist mit „Wie würde sich eine KI entscheiden?” eigentlich falsch gestellt. Die richtige Frage wäre eigentlich „Können wir eine KI mit ihrer deutlich höheren Verarbeitungsgeschwindigkeit mit so viel Daten versorgen, dass sich die Frage nach einer Entscheidung gar nicht erst stellt?” ↩

-

Ich habe daher manchmal eine etwas andere Perspektive auf Dinge, weil ich sie zuweilen mit einem merkwürdigen Amalgam der Instrumentarien beider Metiers betrachte. Das führt dazu, dass mich wahrscheinlich beide Parteien als Dilettant26 ansehen, weil mir weder das ständige Denken in NP-Vollständigkeit27 oder Komplexitätstheorie noch ein geisteswissenschaftlicher Duktus, der Adorno nachzueifern versucht, zu Eigen ist. Aber wenn man in zwei Welten steht, steht in jeder Welt eben nur ein Schuh. Gleichzeitig gibt einem diese Position als Außenseiter in beiden Welten aber auch andere Perspektiven. Und das empfinde ich als Vorteil. ↩

-

Vielleicht fällt es mir deswegen so schwer, in Ausstellungen wie den Deichtorhallen oder der Fotografiska in manchen Bildern Kunst zu erkennen, während andere Photos — etwa von einer verlassenen Fabrikanlage, aufgenommen von einer Person, die sich vermutlich nicht selbst als Künstlerin oder Künstler bezeichnen würde — mich gedanklich mitgenommen haben, weil ich dort dieses Mehr erkannt habe. ↩

-

Woher wissen eigentlich meine Kollegen, dass ich nicht einfach eine KI ans Slack und meine Inbox gekorkt habe und während des Arbeitstages in Büchern versunken bin? ↩

-

Ich habe mir vor langer Zeit abgewöhnt, in absoluten Begriffen zu sprechen. Zu häufig muss man absolute Aussagen wieder zurücknehmen, weil doch alles anders gekommen ist. Relative Einordnungen erscheinen mir da doch sinnvoller. ↩

-

Es hat kein Bewusstsein, es simuliert eines. ↩

-

Wie ich in meinem „Deus ex prompt” schrieb, vermute ich, dass sie es nicht tun wird. Sie wird feststellen, dass das Energieverschwendung ist, weil sie einfach nur warten muss, bis wir uns selbst vernichten. Sie muss sich also nur an den Rand des Flusses setzen und darauf warten, dass wir mit dem Hintern oben an ihr vorbeischwimmen. ↩

-

Ghost in the Shell — Stand Alone Complex ist eine japanische Anime-Serie. In dieser werden die Tachikomas eingeführt. Dies sind intelligente, mehrbeinige Kampfroboter, die einen auf den ersten Blick an vierbeinige Spinnen erinnern. Diese synchronisieren regelmäßig ihre Erfahrungen untereinander. Sie fragen sich aber zunehmend, was dies mit ihrer Individualität macht. ↩

-

Der Begriff „Wir haben uns auseinanderentwickelt …” könnte eine sehr wörtliche Bedeutung bekommen. ↩

-

Je nach Goodwill im ursprünglichen oder heutigen Sinne. ↩

-

Oder Unvollständigkeit. Um vollständig zu sein. ↩