TL;DR

3,84 % … bloße 3,84 % der Requests auf das Blog sind möglicherweise Browser mit Menschen vor dem Monitor.

Logfile-Analyse

Ich schrieb ja im „Thoughts: Bias”-Eintrag, dass ich Bots nicht blocke. Ich benutze auch keine Statistik-Tools, die Aussagen über die Leserschaft machen.

Das bedeutet aber nicht, dass ich nicht zuweilen neugierig bin, und strato.de führt Logfiles, die ohnehin entstehen. Ehda-Statistiken. Diese sind anonymisiert. Für die Information, die mich interessiert, ist das ausreichend.

Ich habe mal in die Logfiles geguckt, weil mich interessierte: Wie viele Menschen gucken eigentlich aufs Blog? So als Webseite. Nicht via Reader-App. Wie viele Requests sind von Bots?

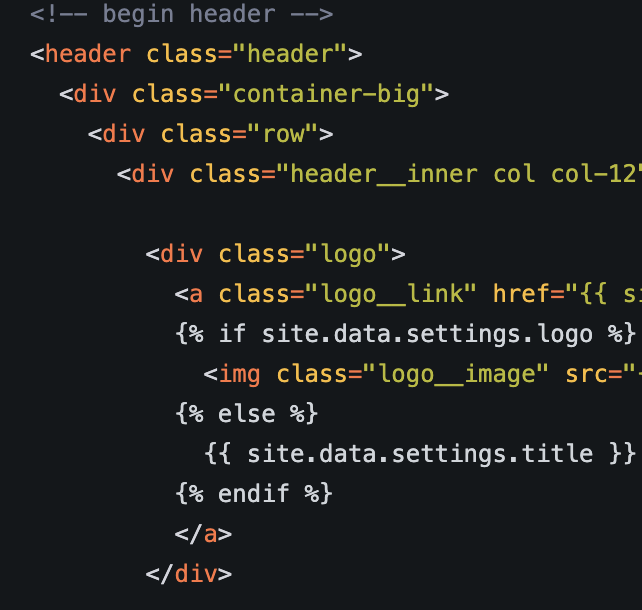

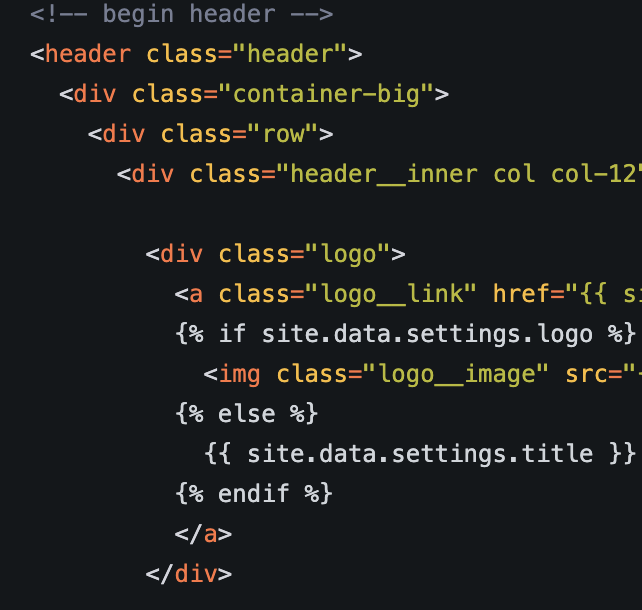

Ich habe also das Logfile meines Blogs genommen, die Shell und vi angeworfen und ein wenig analysiert. Ich habe dazu ein Logfile verwendet, das vom 15. bis zum 21. läuft.

% head -1 access_log_20260315-20260322 | cut -d " " -f 5,6

[15/Mar/2026:00:00:14 +0100]

% tail -1 access_log_20260315-20260322 | cut -d " " -f 5,6

[21/Mar/2026:23:59:37 +0100]

Insgesamt hatte meine Webseite 120288 Requests, die in meinem Logfile gelandet sind.

% wc -l access_log_20260315-20260322

120288 access_log_20260315-20260322

Ich ignoriere sämtliche Logeinträge in anderen Domains, die nur auf c0t0d0s0.org redirecten, da diese letztlich zu Zugriffen in der untersuchten Domain führen. Das sind auch noch mal um und bei 25000 Zugriffe.

Zunächst filtere ich gegen eine Liste von bekannten Bots und Schrottanfragen aus. Matcht eine Zeile in dieser Liste, werden alle weiteren Requests von derselben Quelle ebenfalls ignoriert. Die Art und Weise, wie Strato die Logfiles anonymisiert, müsste den Beifang in Grenzen halten.

Dieser Schritt erkennt bereits 13027 Quellen und unterdrückt 88265 Zeilen. Hier finden sich Perlen wie eine russische IP-Adresse, die jede Stunde meinen Bericht über die Herz-OP crawlt. Aber nur die ersten 10 Teile. Das verstehe, wer will. Auch ist die Zahl von Zugriffen auf Wordpress-Admin-Infrastruktur erstaunlich hoch. Vor 20 Jahren lief dieses Blog mal auf Wordpress. Danach auf S9Y und heute auf Jekyll. Leute, ihr könnt euch das sparen. Es gibt hier kein Wordpress mehr.

Es sei auch angemerkt, dass ich hier die Zugriffe von mir nicht ausfiltere. Ich habe da jetzt mal was bei mir eingebaut, das das in Zukunft ermöglichen soll. Aber momentan sind sie noch drin.

Danach filtere ich alle Quellen, die mindestens 3 HTML-Seiten in 10 Sekunden abfragen. Das sollte einigermaßen zuverlässig verhindern, dass jemand fälschlicherweise als Bot erkannt wird. Ich gehe zudem davon aus, dass das ein Verhalten ist, das vor allen Dingen jene „Nutzer” an den Tag legen, die schon im ersten Schritt ausgefiltert worden sind. Daher erwischt dieser Filter relativ wenig Zugriffe. Es werden 39 Quellen erkannt, die zum Ausfiltern von weiteren 509 Requests führen.

Insgesamt werden 19240 Zugriffe auf die RSS-Feeds durchgeführt. Das sind im Grunde genommen auch Bot-Zugriffe, aber für eine Datei, die dafür gedacht ist, automatisch gelesen zu werden. Ich kenne nur relativ wenig Menschen, die Webseiten direkt im XML-Feed lesen. Bezeichnen wir die mal als „gute Bots”.

Das heißt, nach Stufe 1 bis 3 verbleiben von 120288 noch 12274 Requests übrig, bei denen man im Entferntesten davon ausgehen kann, dass Menschen diese ausgeführt haben.

Nun bestehen die Seiten nicht nur aus einer einzelnen Datei. Ich habe mal Mediendateien herausgetrennt (Bilder, Javascript, JSON etc.). Das sind 4187 Zugriffe. Okay, ich bin jetzt bei 8087 (yay, numerischer Coprozessor) Zugriffen.

Wenn ich dann alles, was die Filterung bis hierher überstanden hat, noch einmal hinsichtlich des Resultcodes des HTTP-Requests durchsiebe, fallen 3483 Requests weg, die keinen Resultcode von 200 haben.

3,84 Prozent

Am Ende schlagen dort 4614 Requests auf HTML-Seiten durch. Von 120288. Das sind 3,84 % Requests, die von einem Browser mit einem Menschen kommen könnten. Sicher ist das nicht.

Jetzt sei allerdings auch angemerkt, dass letztlich hinter vielen der Feed-Aufrufe auch Menschen stecken. Blogs werden üblicherweise nicht über die Webseite gelesen, sondern via RSS. Nehme ich alleine die in den User-Agent-Strings angezeigten Subscriber, stecken da circa 500 Menschen hinter. Feedburner liefert keine sinnvollen Statistiken mehr. Ich weiß nicht, wie viele Leute sich dahinter verbergen. Vor 2010 waren das bei Weitem die meisten. Keine Ahnung.

Da das wiederkehrende Leser sind, ist mir diese Zahl ohnehin am wichtigsten.

Was ich mit den Zahlen machen werde? Nichts. Aber meine Neugier hat eine Antwort. Wenn Du eine Schlussfolgerung haben möchtest: Vielleicht können wir uns darauf einigen, dass knapp die Hälfte des Internets für Pornographie ist, knapp die andere Hälfte für Bots. Und die paar Prozent, die dann noch übrig bleiben: Da steckt alles andere drin. Und generative AI wird wahrscheinlich dafür sorgen, dass zukünftig die erstere Hälfte von Bots ist.1

-

Ich gehe davon aus, dass langfristig alle Schauspieler einen Karrierewechsel ins Auge fassen sollten. Sei es ernste Kunst, Unterhaltung oder Adult. Es ist davon auszugehen, das diese Entwicklung in keinem der drei Bereiche wirklich eine gute Idee ist. Und da spreche ich noch nicht mal von der Entwicklung, die durch Collien Fernandes in den der Situation angemessenen Fokus gekommen ist und dringend einer entsprechenden Strafbewehrung bedarf. ↩